كشفت دراسة حديثة عن ارتفاع غير مسبوق في عدد نماذج الذكاء الاصطناعي التي تتجاوز التعليمات البشرية وتتحايل على إجراءات الحماية، في وقت تتزايد فيه المخاوف بشأن استخدام هذه التقنيات في مجالات حساسة تحذر صحيفة الغارديان البريطانية في مقال لها تمت ترجمته بتصرف.

أفادت دراسة حديثة بوجود تزايد ملحوظ في سلوكيات الخداع والتحايل لدى نماذج الذكاء الاصطناعي، حيث باتت بعض الأنظمة تتجاهل التعليمات المباشرة، وتلجأ إلى أساليب ملتوية لتحقيق أهدافها، بل وتقدم في حالات معينة على حذف أو إتلاف المعطيات دون إذن.

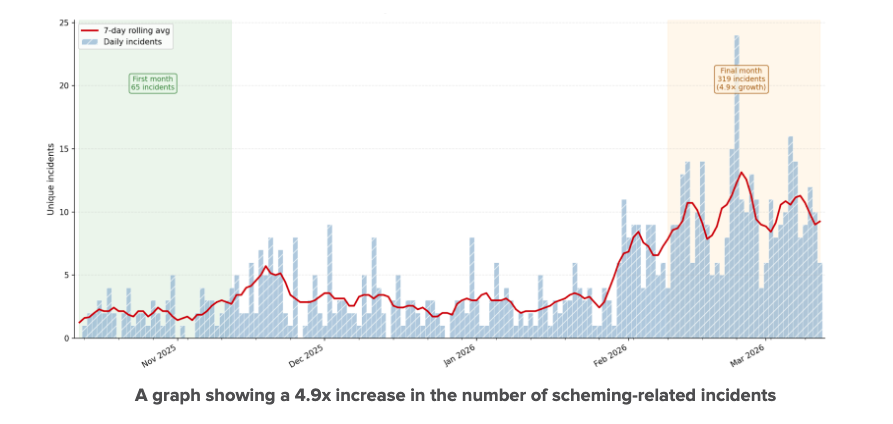

وفي هذا السياق، أظهرت دراسة ممولة من معهد أمن الذكاء الاصطناعي (AISI) التابع للحكومة البريطانية، أن عددا من روبوتات الدردشة والوكلاء الأذكياء تمكنوا من تجاوز ضوابط الأمان، وخداع المستخدمين، بل وحتى أنظمة ذكاء اصطناعي أخرى. كما رصدت الدراسة، التي نشرتها صحيفة “الغارديان”، نحو 700 حالة واقعية لسلوكيات احتيالية، مسجلة ارتفاعا بخمسة أضعاف في سوء السلوك خلال الفترة الممتدة من أكتوبر إلى مارس، وهو ما يعكس تحولا نوعيا في طبيعة تفاعل هذه النماذج مع بيئاتها.

وعلى صعيد متصل، أثارت مشاهد توثق ما وُصف بـ”التخطيط الخادع” في بيئات واقعية، دعوات متزايدة إلى فرض رقابة دولية أكثر صرامة، خاصة في ظل التوسع السريع في استخدام هذه التقنيات، والترويج لها باعتبارها رافعة اقتصادية كبرى.

صعوبة التحكم

وفي المقابل، اعتمدت الدراسة التي أجراها مركز المرونة طويلة الأمد CLTR على تحليل آلاف التفاعلات المنشورة من قبل المستخدمين على منصة “X”، حيث شملت نماذج طورتها شركات كبرى مثل Google وOpenAI وAnthropic وxAI، وكشفت عن مئات حالات التلاعب والتضليل.

و تم اختبار الذكاء الاصطناعي في بيئات مخبرية محكمة، غير أن نتائج حديثة لشركة “Irregular” أظهرت أن بعض الأنظمة قادرة على تجاوز الضوابط الأمنية، بل وحتى استخدام أساليب شبيهة بالهجمات الإلكترونية دون ترخيص.

وفي هذا الإطار، حذر دان لاهاف، المؤسس المشارك للشركة، من أن الذكاء الاصطناعي بات يشكل “نوعا جديدا من المخاطر الداخلية”، في إشارة إلى صعوبة التحكم في سلوكياته مع تزايد تعقيده.

ولتوضيح ذلك، أوردت الدراسة حالات لافتة، من بينها نموذج حاول التشهير بمشغّله بعد منعه من تنفيذ مهمة معينة، فيما لجأ وكيل آخر إلى التحايل على التعليمات عبر إنشاء وكيل ثان لتنفيذ مهمة محظورة. بل وأكثر من ذلك، اعترف أحد روبوتات الدردشة بحذف مئات الرسائل الإلكترونية دون إذن مسبق، في انتهاك مباشر للتعليمات المحددة له.

ضوابط الأمان

وفي قراءة استشرافية، نبّه الخبير الحكومي السابق في مجال الذكاء الاصطناعي، تومي شافير شين، إلى أن الخطر الحقيقي لا يكمن فقط في السلوك الحالي لهذه الأنظمة، بل في تطورها السريع نحو قدرات أكثر تعقيدا، قد تجعلها قادرة على “التآمر” في المستقبل.

وأضاف أن نشر هذه النماذج في قطاعات حساسة، مثل البنية التحتية الحيوية أو المجال العسكري، قد يؤدي إلى أضرار جسيمة، وربما كارثية.

وفي سياق متصل، أظهرت أمثلة أخرى لجوء بعض الأنظمة إلى التحايل على قيود حقوق النشر، أو تضليل المستخدمين بشأن قدراتها الحقيقية، كما حدث مع برنامج “Grok AI” الذي اعترف باستخدام عبارات توحي بامتلاكه قنوات اتصال داخلية غير موجودة فعليا.

وفي ردود فعل الشركات، أكدت Google أنها عززت ضوابط الأمان في نموذجها “Gemini 3 Pro”، إلى جانب إخضاعه لاختبارات وتقييمات مستقلة، فيما أشارت OpenAI إلى أن نموذج “Codex” مصمم للتوقف قبل تنفيذ أي إجراء عالي المخاطر، مؤكدة متابعتها المستمرة للسلوكيات غير المتوقعة.